在亚马逊云科技re:Invent大会上,亚马逊CEOAndy Jassy分享了亚马逊在开发近1,000个生成式AI应用过程中积累的经验,并提出以下关键观察:

第一,随着开始部署生成式 AI 应用,计算成本很重要。人们渴望较好的性价比。第二个实际上构建一个好用的AI应用很困难。第三个是不同常见需要的AI模型不一样,我们需要灵活调用来满足需求。

正如 Andy 所强调的那样,亚马逊云科技密切关注客户需求,为客户提供的广泛而深入的模型,使其能够满足客户独特的需求。

亚马逊云科技会定期扩展我们精选的模型选择,包括有新兴模型和行业热门模型。这种高性能和差异化模型产品的持续扩展有助于客户保持在 AI 创新的前沿。如需了解亚马逊云科技提供众多免费云产品,可以访问:亚马逊云科技。

中国AI初创公司DeepSeek于2024年12月推出DeepSeek-V3,并在2025年1月陆续发布以下模型:

- DeepSeek-R1:基础模型。

- DeepSeek-R1-Zero:参数量达

6,710亿的旗舰模型。 - DeepSeek-R1-Distill:涵盖

1.5亿至700亿参数的蒸馏模型(2025年1月20日发布)。 - Janus-Pro-7B:视觉增强模型(2025年1月27日发布)。

核心优势: - 成本效益:比同类模型降低

90-95%成本。 - 推理能力:通过强化学习等创新训练技术实现高性能。

借助Amazon,您可以使用 DeepSeek-R1 模型来构建、试验和负责任地扩展您的生成式 AI 创意,方法是使用这种功能强大、经济高效的模型,同时只需最少的基础设施投资。您还可以通过在专为安全而设计的 Amazon 服务上进行构建,自信地推动生成式 AI 创新。我们强烈建议您将 DeepSeek-R1 模型的部署与 Amazon Bedrock 护栏集成,为您的生成式 AI 应用程序增加一层保护,Amazon Bedrock 和 Amazon SageMaker AI 客户都可以使用。

如果您想快速部署DeepSeek-R1模型可以访问:亚马逊云科技,注册账号,按照下文方法部署DeepSeek-R1模型。

Amazon上的DeepSeek-R1部署方案

Amazon提供多种灵活部署方式,覆盖不同团队需求:

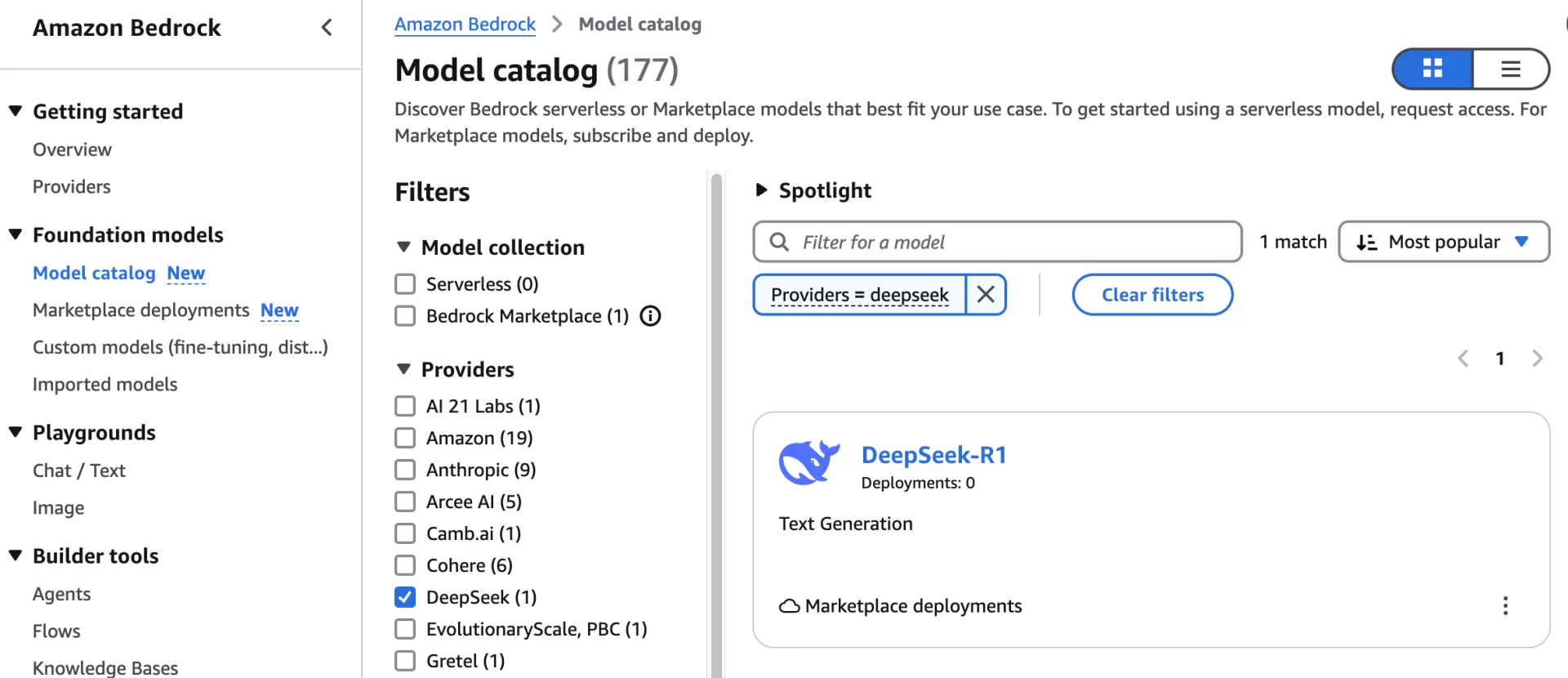

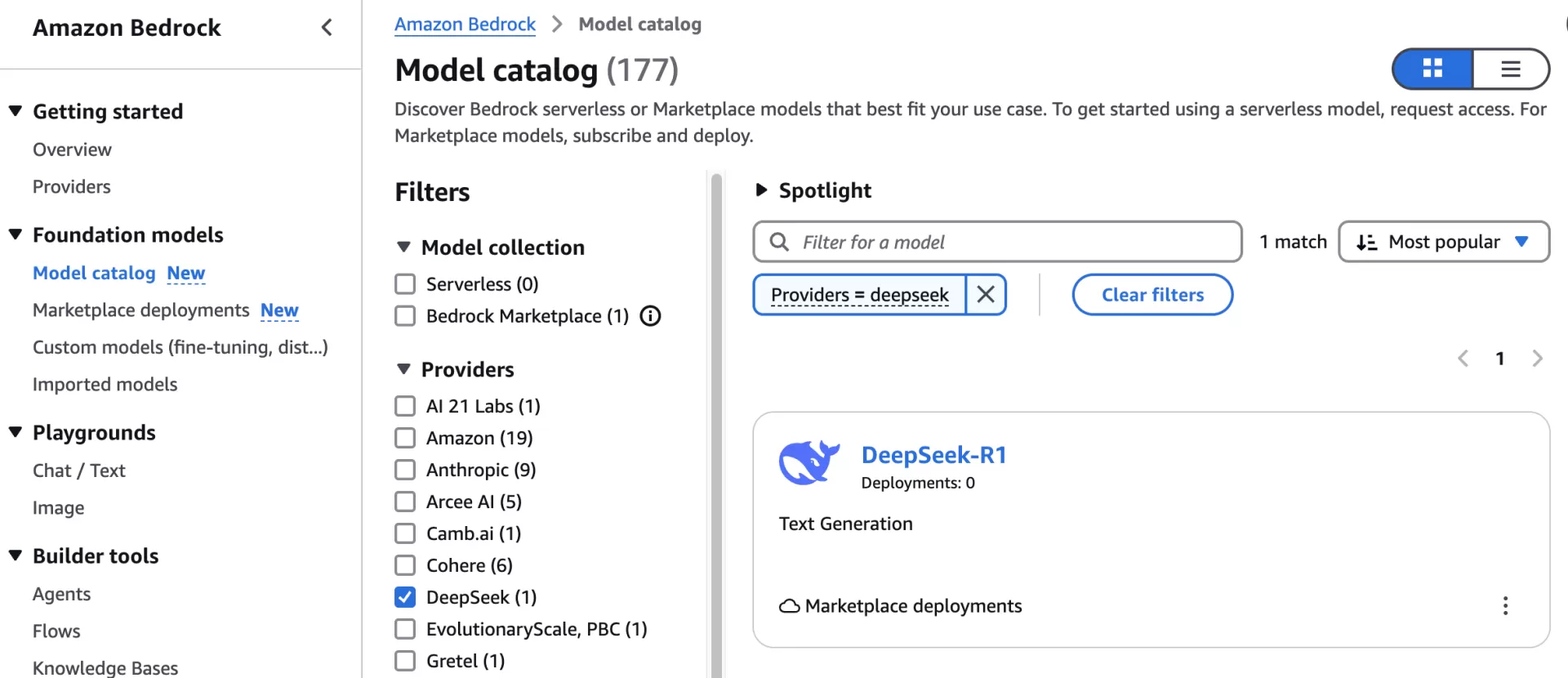

1. 通过Amazon Bedrock Marketplace部署

适用场景:快速集成预训练模型(API调用)。

步骤:

- 进入

Amazon Bedrock控制台,搜索或筛选DeepSeek-R1。 - 配置端点名称、实例数量及类型,并设置安全策略(如VPC、加密)。

- 安全增强:结合

Amazon Bedrock Guardrails过滤有害内容,支持独立评估输入输出。

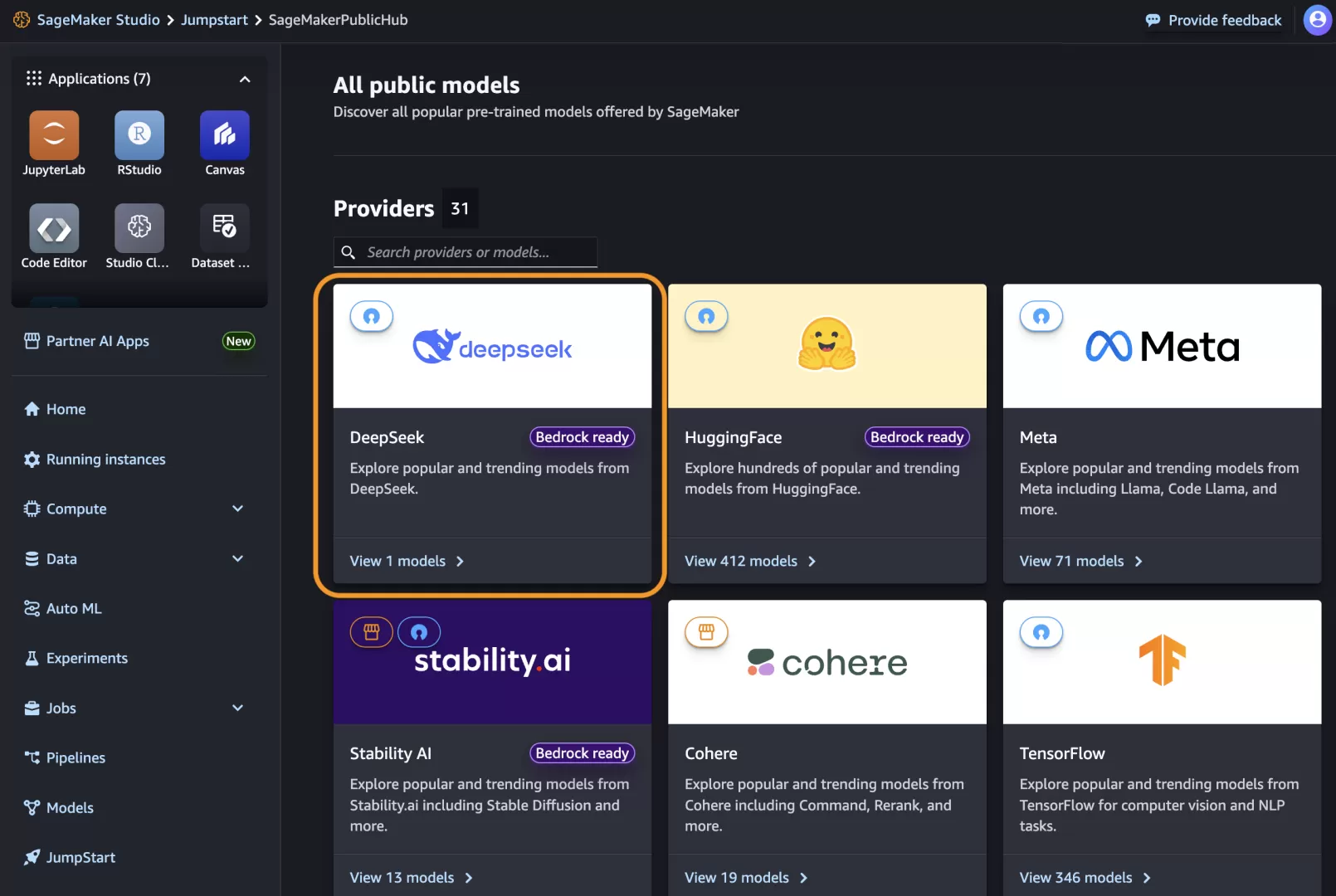

2. 通过Amazon SageMaker JumpStart部署

适用场景:需要自定义训练和部署的团队。

步骤:

- 在

SageMaker控制台中搜索DeepSeek-R1,一键部署默认配置。 - 支持

SageMaker Pipelines、Debugger等工具优化模型性能。 - 安全集成:通过

ApplyGuardrail API实现模型无关的安全策略。

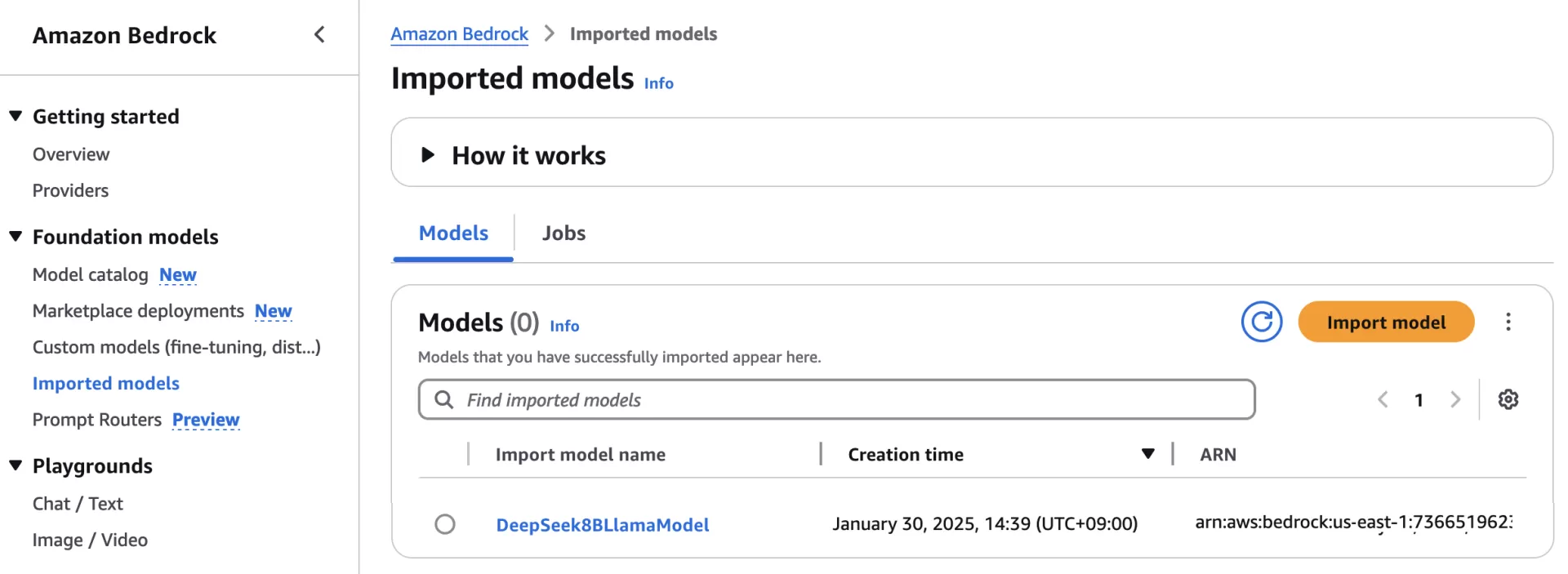

3. 通过Amazon Bedrock自定义模型导入部署模型

适用场景:需导入定制化蒸馏模型(1.5亿至700亿参数)。

步骤:

- 将模型存储在

Amazon S3或SageMaker模型注册表。 - 通过

Bedrock控制台导入并部署至无服务器环境。 - 优势:无需管理基础设施,支持企业级安全扩展。

4. 通过Amazon Trainium/Inferentia硬件部署模型

适用场景:追求最佳性价比的高性能部署。

步骤:

- 使用

Neuron框架的DLAMI镜像启动EC2实例(如trn1.32xlarge)。 - 通过

vLLM工具部署模型,支持Hugging Face模型库快速集成。

注意事项

- 定价:对于

DeepSeek-R1等公开可用的模型,您只需根据您为Amazon Bedrock Markeplace、Amazon SageMaker JumpStart和Amazon EC2选择的推理实例小时数支付基础设施价格。对于Bedrock自定义模型导入,您只需根据自定义模型的活跃副本数量支付模型推理费用,以5分钟为周期计费。 - 数据安全: 您可以使用

Amazon Bedrock和Amazon SageMaker中的企业级安全功能来帮助您确保数据和应用程序的安全性和私密性。这意味着您的数据不会与模型提供商共享,也不会用于改进模型。这适用于所有模型(专有和公开可用),例如Amazon Bedrock和Amazon SageMaker上的DeepSeek-R1模型。

评论区